Разведочный анализ данных. Лабораторная «Применение методов первичного разведочного анализа данных в решении задач интеллектуального анализа данных (ИАД) средствами интегрированной системы Statistica Разведывательный анализ данных

Разведочный анализ данных (РАД; Exploratory data analysis) употребляется, когда, с одной стороны, у исследователя имеется таблица многомерных данных, а с другой стороны, априорная информация о физическом (причинном) механизме генерации этих данных отсутствует или неполна. В этой ситуации РАД может оказать помощь в компактном и понятном исследователю описании структуры данных (например, в форме визуального представления этой структуры), отталкиваясь от которого он уже может «прицельно» поставить вопрос о более детальном исследовании данных с помощью того или иного раздела статистического анализа, обоснования полученной структуры данных с помощью аппарата проверки статистических гипотез, а также, возможно, сделать некоторые заключения и о причинной модели данных. Этот этап называется «подтверждающим анализом данных» (confirmatory data analysis). Иногда выявление структуры данных с помощью РАД может оказаться и завершающим этапом анализа. С другой стороны, ряд методов РАД можно рассматривать и как методы подготовки данных для последующей статистической обработки без какого-либо изучения структуры данных, которое предполагается осуществить на последующих этапах.

В этом случае этап РАД играет роль некоторого этапа перекодировки и преобразования данных (путем, например, сокращения размерности) в удобную для последующего анализа форму. В любом случае, с какой бы целью ни применялись методы РАД, основная задача - переход к компактному описанию данных при возможно более полном сохранении существенных аспектов информации, содержащихся в исходных данных. Важно также, чтобы описание было понятным для пользователя. Впервые термин «разведочный анализ данных» был введен Дж. Тьюки в 1962 г.

Модели структуры многомерных данных. Пусть данные заданы в виде матрицы данных. Объекты можно представить в виде точек в многомерном (р-мерном) пространстве. Для описания структуры этого множества точек в РАД используется одна из следующих статистических моделей:

а) модель облака точек примерно эллипсоидальной конфигурации;

б) кластерная модель, т. е. совокупность нескольких «облаков» точек, достаточно далеко отстоящих друг от друга;

в) модель «засорения» (компактное облако точек и при этом присутствуют далекие выбросы);

г) модель носителя точек как многообразия (линейного или нелинейного) более низкой размерности, чем исходное; типичным примером является выборка из вырожденного распределения;

д) дискриминантная модель, когда точки разделены некоторым образом на несколько групп и дана информация о их принадлежности к той или иной группе.

В рамках модели можно рассматривать и регрессионную модель, когда соответствующее многообразие допускает функциональное представление , где - две группы переменных из исходного набора (переменные из носят тогда название прогнозируемых переменных, а из - предсказывающих переменных); - ошибка предсказания.

Разумеется, реальные данные обычно лишь приближенно могут следовать этим моделям, более того, структура данных может не подходить ни под одну из указанных в описании моделей даже приближенно.

Модели описания структуры зависимостей. В пространстве переменных для описания структуры зависимостей между переменными часто используются следующие модели: модель независимых переменных, модель линейно зависимых переменных, древообразная модель зависимости, факторная модель для линейно зависимых переменных, кластерная модель (произвольные коэффициенты связи), иерархическая модель зависимости.

Основные методические приемы при проведении разведочного анализа данных. Способы анализа и интерпретации результатов в значительной степени зависят от выбранного метода обработки. Однако можно выделить ряд эффективных приемов и подходов к анализу результатов, которые являются наиболее общими и в значительной степени определяют специфику собственно разведочного анализа, отличают его от остальных этапов статистической обработки. Это визуализация данных и манипуляции с данными на основе графического отображения; использование аппарата активных и иллюстративных переменных; преобразование данных, облегчающее выявление структур, анализ остатков.

Ответ:

С помощью графических методов можно находить зависимости, тренды и смещения, "скрытые" в неструктурированных наборах данных.

К методам визуализации относятся:

Представление данных в виде столбчатых, линейных диаграмм в многомерном пространстве;

Наложение и объединение нескольких изображений;

Идентификация и маркировка подгрупп данных, удовлетворяющих определенным условиям;

Расщепление или слияние подгрупп данных на графике;

Агрегирование данных;

Сглаживание данных;

Построение пиктографиков;

Создание мозаичных структур;

Спектральных плоскостей, карт линий уровня; методы динамического вращения и динамического расслоения трехмерных изображений; выделение определенных наборов и блоков данных и т.д.

Типы графиков в Statistica:

§ двумерные графики;(гистограммы)

§ трехмерные графики;

§ матричные графики;

§ пиктографики.

Ответ: Эти графики представляют собой наборы двумерных, трехмерных, тернарных или n-мерных графиков (таких как гистограммы, диаграммы рассеяния, линейные графики, поверхности, круговые диаграммы), по одному графику для каждой выбранной категории (подмножества) наблюдений.

График представляет собой набор графиков, круговые диаграммы для каждой определенной категории выбранной переменной (2 пола – по 2м полам).

Структура категоризированных данных может быть обработана аналогичным образом. : например накоплена статистика о покупателях и необходимо провести анализ суммы покупки по различным категориям (мужчины-женщины, старики-зрелые-молодежь).

В статистике – гистограммы, диаграммы рассеяния, линейные графики, круговые диаграммы, 3мерные графики, 3мерные тернарные графики

Как вы можете видеть, эта переменная в целом имеет для каждой группы (типа цветов) нормальное распределение.

5. Какую информацию о природе данных можно получить при анализе диаграмм рассеяния и категоризованных диаграмм рассеяния?

Ответ:

Диаграммы рассеяния обычно используются для выявления природы взаимосвязи двух переменных (например, прибыль и фонд заработной платы), поскольку они предоставляют гораздо больше информации, чем коэффициент корреляции.

Если предполагается, что один из параметров зависит от другого, то обычно значения независимого параметра откладывается по горизонтальной оси, а значения зависимого - по вертикальной. Диаграммы рассеяния используются для демонстрации наличия или отсутствия корреляции между двумя переменными.

Каждая точка, отмеченная на диаграмме, включает две характеристики, например возраст и доход индивида, отложенные каждая по своей оси. Нередко это помогает выяснить, существует ли какая-либо значимая статистическая связь между этими характеристиками и какой тип функции имеет смысл подбирать. А

6. Какую информацию о природе данных можно получить на основе анализа гистограмм и категоризованных гистограмм?

Ответ

: Гистограммы используются для изучения распределений частот значений переменных. Такое частотное распределение показывает, какие именно конкретные значения или диапазоны значений исследуемой переменной встречаются наиболее часто, насколько различаются эти значения, расположено ли большинство наблюдений около среднего значения, является распределение симметричным или асимметричным, многомодальным (т.е. имеет две или более вершины) или одномодальным и т.д. Гистограммы также используются для сравнения наблюдаемых и теоретических или ожидаемых распределений.

Категоризованные гистограммы представляют собой наборы гистограмм, соответствующих различным значениям одной или нескольких категоризующих переменных или наборам логических условий категоризации.

Гистограмма, это способ представления статистических данных в графическом виде – в виде столбчатой диаграммы. Она отображает распределение отдельных измерений параметров изделия или процесса. Иногда ее называют частотным распределением, так как гистограмма показывает частоту появления измеренных значений параметров объекта.

Высота каждого столбца указывает на частоту появления значений параметров в выбранном диапазоне, а количество столбцов – на число выбранных диапазонов.

Важное преимущество гистограммы заключается в том, что она позволяет наглядно представить тенденции изменения измеряемых параметров качества объекта и зрительно оценить закон их распределения. Кроме того, гистограмма дает возможность быстро определить центр, разброс и форму распределения случайной величины. Строится гистограмма, как правило, для интервального изменения значений измеряемого параметра.

7. Чем принципиально отличаются категоризованные графики от матричных графиков в системе Statistica?

Ответ:

Матричные графики также состоят из нескольких графиков; однако здесь каждый из них основывается (или может основываться) на одном и том же множестве наблюдений, и графики строятся для всех комбинаций переменных из одного или двух списков.

атричные графики. На матричных графиках изображаются зависимости между несколькими переменными в форме матрицы XY-графиков. Наиболее распространенным типом матричного графика является матрица диаграмм рассеяния, которую можно считать графическим эквивалентом корреляционной матрицы.

Матричные графики - Диаграммы рассеяния. На матричном графике этого типа изображаются 2М диаграммы рассеяния, организованные в форме матрицы (значения переменной по столбцу используются в качестве координат X , а значения переменной по строке - в качестве координат Y ). Гистограммы, изображающие распределение каждой переменной, располагаются на диагонали матрицы (в случае квадратных матриц) или по краям (в случае прямоугольных матриц).

См. также раздел Сокращение объема выборки.

Для категоризованных графиков требуется такой же выбор переменных, как и для некатегоризованных графиков соответствующего типа (например, две переменных для диаграммы рассеяния). В то же время для категоризованных графиков необходимо указать по крайней мере одну группирующую переменную (или способ разбиения наблюдений на категории), где содержалась бы информация о принадлежности каждого наблюдения к определенной подгруппе. Группирующая переменная не будет непосредственно изображена на графике (т.е. не будет построена), однако она будет служить критерием для разделения всех анализируемых наблюдений на отдельные подгруппы. Для каждой группы (категории), определяемой группирующей переменной, будет построен один график.

8. В чем достоинства и недостатки графических методов разведочного анализа данных?

Ответ: + Наглядность и простота.

Наглядность (многомерное графическое представление данных, по которому аналитик сам выявляет закономерности и отношения между данными).

- Методы дают приближенные значения.

n - Высокая доля субъективизма в интерпретации результатов.

n Отсутствие аналитических моделей.

9. Какие аналитические методы первичного разведочного анализа данных вы знаете?

Ответ: Статистические методы, нейронные сети.

10. Как проверить гипотезу о согласии распределения выборочных данных с моделью нормального распределения в системе Statistica?

Ответ: Распределение x 2 (хи-квадрат) с n степенями свободы - это распределение суммы квадратов n независимых стандартных нормальных случайных величин.

Хи-квадрат - это мера различия. Задаем уровень ошибки, равный a=0,05. Соответственно, если значение p>a , то распределение оптимально.

- для проверки гипотезы о согласии распределения выборочных данных с моделью нормального распределения с помощью критерия хи-квадрат выберите пункт меню Statistics/Distribution Fittings. Затем в диалоговом окне Fitting Contentious Distribution задайте вид теоретического распределения - Normal, выберите переменную - Variables, задайте параметры анализа - Parameters.

11. Какие основные статистические характеристики количественных переменных вы знаете? Их описание и интерпретация в терминах решаемой задачи.

Ответ: Основные статистические характеристики количественных переменных:

математическое ожидание (среднее среди выборки, сумма значений\n ,седнирй объем производства среди предприятий)

медиана(середина значений.)

среднее квадратичное отклонение (Квадратный корень из дисперсии)

дисперсия (мера разброса данной случайной величины, т.е. её отклонения от математического ожидания)

коэффициент асимметрии (Определяем смещение относительно центра симметрии по правилу: если B1>0, то смещение влево, иначе - вправо.)

коэффициента эксцесса (близость к нормальному распределению)

минимальное выборочное значение, максимальное выборочное значение,

разброс

выборочные верхнюю и нижнюю квартили

Мода (пиковое значение)

12. Какие измерители связи применяются для измерения степени тесноты связи между количественными и порядковыми переменными? Их расчет в Statistica и интерпретация.

Ответ: Корреляция - статистическая взаимосвязь двух или нескольких случайных величин.

При этом изменения одной или нескольких из этих величин приводят к систематическому изменению другой или других величин. Мерой корреляции двух случайных величин служит коэффициент корреляции.

Количественные:

Коэффициент корреляции - это показатель характера изменения двух случайных величин.

Коэффициента корреляции Пирсона (измеряет степень линейных связей между переменными. Можно сказать, что корреляция определяет степень, с которой значения двух переменных пропорциональны друг другу.)

Частный коэффициент корреляции (измеряет степень тесноты между переменными, при условии что значения остальных переменных зафиксированы на постоянном уровне).

Качественные:

Коэффициент ранговой корреляции Спирмена (используется с целью статистического изучения связи между явлениями. Изучаемые объекты упорядочиваются в отношении некоторого признака т. е. им приписываются порядковые номера - ранги.)

| | | следующая лекция ==> | |

Обновлено 29.07.2008

Мои достаточно сумбурные мысли на тему применения статистических методов при обработке протеомных данных.

ПРИМЕНЕНИЕ СТАТИСТИКИ В ПРОТЕОМИКЕ

Обзор методов для анализа экспериментальных данных

Пятницкий М.А.

ГУ НИИ биомедицинской химии им. В.Н. ОреховичаРАМН

119121, Москва, Погодинская ул. д.10,

e -mail : mpyat @ bioinformatics . ru

Протеомные эксперименты требуют тщательной продуманной статистической обработки результатов. Существует несколько важных черт, характеризующих протеомные данные:

- имеется большое количество переменных

- сложные взаимосвязи между этими переменными. Подразумевается, что эти взаимосвязи отражают биологические факты

- число переменных много больше числа образцов. Это очень затрудняет работу многих статистических методов

Впрочем, подобные признаки присущи и многим другим данным, полученных с помощью high-throughput технологий.

Типичными задачами протеомного эксперимента являются:

- сравнение профилей экспрессии белков между разными группами (например, рак/норма). Обычно задачей является построение решающего правила, позволяющего отделить одну группу от другой. Также представляют интерес переменные, обладающие наибольшей дискриминаторной способностью (биомаркеры).

- изучение взаимосвязей между белками.

Здесь я сосредоточусь в основном на применении статистики для анализа масс-спектров. Однако многое из сказанного относится и к другим типам экспериментальных данных. Здесь почти не рассматриваются сами методы (за исключением более подробного описания ROC -кривых), а скорее очень кратко обрисован арсенал методов для анализа данных и даются наметки к осмысленному его применению.

Разведочный анализ

Важнейшим шагом при работе с любым массивом данных является разведочный анализ, exploratory data analysis (EDA). На мой взгляд, это едва ли не самый главный момент при статистической обработке данных. Именно на этом этапе нужно получить представление о данных, понять какие методы лучше применять и, что более важно, каких результатов можно ожидать. В противном случае, это будет игра “вслепую” (а давайте попробуем такой-то метод), бессмысленный перебор арсенала статистики, data dredging. Статистика тем и опасна, что всегда выдаст какой-либо результат. Сейчас, когда запуск сложнейшего вычислительного метода требует всего пары щелчков мышью, это особенно актуально.

Согласно Tukey, целями разведочного анализа являются:

- maximise insight into a data set;

- uncover underlying structure;

- extract important variables;

- detect outliers and anomalies;

- test underlying assumptions;

- develop parsimonious models; and

- determine optimal factor settings.

На этом этапе разумно получить как можно больше информации о данных, используя в первую очередь графические средства. Постройте гистограммы для каждой переменной. Как это не банально, взгляните на описательную статистику. Полезно посмотреть на графики рассеяния (при этом рисуя точки различными символами, индицирующими принадлежность к классам). Интереснопосмотретьнарезультаты PCA (principal component analysis) и MDS(multidimensional scaling). Итак, EDA - это в первую очередь широкое применение графической визуализации.

Перспективно применение методов projection pursuit для поиска наиболее “интересной” проекции данных. Обычно, возможна некоторая степень автоматизации этой работы (GGobi ). Произволом является выбор индекса для поиска интересных проекций.

Нормировка

Обычно, данные не являются нормально распределенными, что не удобно для статистических процедур. Часто встречается лог-нормальное распределение. Простым логарифмированием можно сделать распределение куда более приятным. Вообще не стоит недооценивать такие простые методы как логарифмирование и другие преобразования данных. На практике не раз встречаются случаи, когда после логарифмирования начинают получаться осмысленные результаты, хотя до предобработки результаты были малосодержательными (здесь пример про масс-спектрометрию вин).

Вообще, выбор нормировки - это отдельная задача, которой посвящены многие работы. Выбор метода предобработки и шкалирования может существенным образом повлиять на результаты анализа (Berg et al, 2006). На мой взгляд, лучше всегда по умолчанию проводить простейшую нормировку (например , если распределение симметрично или логарифмирование в другом случае), чем вообще не пользоваться этими методами.

Приведем несколько примеров графической визуализации и применения простых методов статистики для разведочного анализа данных.

Примеры

Ниже приведены примеры графиков, которые, возможно, имеет смысл строить для каждой переменной. Слева показаны оценки плотности распределения для каждого из двух классов (красный - рак, синий - контроль). Обратите внимание, что под графиками представлены и сами значения, по которым строится оценка плотности. Справа приведена ROC -кривая, и показана площадь под ней. Тем самым сразу можно видеть потенциал каждой переменной как дискриминаторной между классами. Ведь именно дискриминация между классами обычно является конечной целью статистического анализа протеомных данных.

На следующем рисунке показана иллюстрация нормировки: типичное распределение интенсивности пика на масс-спектре (слева) при логарифмировании дает распределение близкое к нормальному (справа).

Далее покажем применение heatmap для разведочного анализа данных. По столбцам - пациенты, по строкам - гены. Цвет показывает численное значение. Видно четкое разделение на несколько групп. Это отличный пример применения EDA , который сразу дает наглядную картину о данных.

На следующей картине показан пример gel -view графика. Это стандартный прием для визуализации большого набора спектров. Каждая строка - образец, каждый столбец - пик. Цветом закодирована интенсивность значения (чем ярче тем лучше). Такие картинки можно получить, например, в ClinProTools . Но там имеется большой недостаток - строки(образцы) идут в том порядке, в котором они были загружены. Гораздо правильнее переставлять строки(образцы) таким образом, что близкие образцы располагаются рядом и на графике. Фактически это heatmap без сортировки столбцов и дендрограмм по бокам.

На следующей картинке приведен пример применения многомерного шкалирования. Кружки - контроль, треугольники - рак. Видно, что рак имеет существенно большую дисперсию и построение решающего правила вполне возможно. Такой любопытный результат достигается всего для двух первых координат! Глядя на такую картинку, можно преисполнится оптимизмом относительнорезультатов дальнейшей обработки данных.

Проблема пропущенных значений

Следующей проблемой, с которой сталкивается исследователь, является проблема пропущенных значений. Опять-таки, этой теме посвящено множество книг, в каждой из которых описаны десятки способов решения этой задачи. Пропущенные значения часто встречаются в данных, которые получают путемhigh -throughput экспериментов. Многие же статистические методы требуют полных данных.

Приведу основные способы решения проблемы пропущенных значений:

. убрать строки/столбцы с пропущенными значениями. Оправдано, если пропущенных значений относительно немного, иначе придется убирать все

. генерировать новые данные взамен пропущенных (заменять на среднее, получать из оцененного распределения)

. использовать методы нечувствительные к пропущенным данным

. поставить эксперимент еще раз!

Проблема выбросов

Выброс - это образец с резко отличающимися показателями от основной группы. Опять,эта теме глубоко и обширно разработана в соответствующей литературе.

В чем опасность наличия выбросов? В первую очередь, это может существенным образом повлиять на работу неробастных (не устойчивых к выбросам) статистических процедур. Наличие даже одного выброса в данных может существенно изменить оценки среднего и дисперсии.

Выбросы трудно заметны в многомерных данных, поскольку могут проявляться только в значениях одной-двух переменных (напомню, что в типичном случае протеомный эксперимент описывается сотнями переменных). Здесь и пригодится анализ каждой переменной в отдельности - при просмотре описательных статистик или гистограмм (вроде тех, которые были приведены выше) такой выброс легко обнаружить.

Возможны две стратегии для поиска выбросов:

1) вручную - анализ графиков рассеяния, PCA ,и другие методы разведочного анализа. Попробуйте построить дендрограмму - на ней выброс будет виден в виде отдельной ветки, которая рано отходит от корня.

2) 2) разработано множество критериев для обнаружения (Yang , Mardia , Schjwager ,…)

Средства борьбы с выбросами

. удаление выбросов

. применять устойчивые к выбросам(робастные) статистические методы

При этом нужно держать в голове, что возможно выброс - это не ошибка эксперимента, а некий существенно новый биологический факт. Хотя такое, конечно, случается крайне редко, но все же…

На следующем рисунке показаны возможные типы выбросов по типу их влияния на статистики.

Проиллюстрируем, как влияют выбросы на поведение коэффициентов корреляции.

Нас интересует случай (f ) . Видно, как наличие всего 3 выбросов дает значение коэффициента корреляции Пирсона равным 0.68, в то время как коэффициенты Спирмена и Кендалла дают гораздо более разумные оценки (корреляции нет). Правильно, коэффициент корреляции Пирсона - неробастная статистика.

Покажем применение метода PCA для визуального обнаружения выбросов.

Конечно, всегда полагаться на такие “кустарные” методы обнаружения не стоит. Лучше обратиться к литературе.

Классификация и снижение размерности

Обычно, основной целью анализа протеомных данных является построение решающего правила для отделения одной группы образцов от другой (например, рак/норма). После проведения разведочного анализа и нормировки обычно следующим шагом является уменьшение размерности пространства признаков (dimensionality reduction ).

Отбор переменных

Большое число переменных (а это стандартная ситуация в протеомных экспериментах):

. усложняет анализ данных

. обычно не все переменные имеют биологическую интерпретацию

. часто целью работы является отбор “интересных” переменных (биомаркеры)

. ухудшает работу алгоритмов классификации. Из-за этого - переобучение (overfitting ).

Поэтому стандартным шагом является применение dimensionality reduction перед классификацией

Методы dime nsionality reduction можно разделить на 2 типа:

1) Filter

Задачами этой группы методов является либо удаление уже существующих “малоинтересных” переменных, либо создание новых переменных как линейных комбинаций старых. Сюда относятся

PCA , MDS ,

методы теории информации и т.д.

Другой идеей является направленный отбор “интересных переменных”: например, бимодальные переменные всегда интересны для просмотра (в идеале каждый пик соответствует своему классу для бинарной классификации). Впрочем, это можно отнести к разведочному анализу.

Еще одним подходом является исключение сильно скоррелированных между собой переменных. При таком подходе переменные группируются используя коэффициенты корреляции в качестве меры расстояния. Можно использовать не только корреляцию Пирсона, но и другие коэффициенты. Из каждого кластера скорреллированных переменных оставляется только одна (например, по критерию наибольшей площади под ROC -кривой).

На рисунке приведен примервизуализации такого кластерного анализа пиков с помощью heatmap . Матрица симметрична, цвет показывает значения коэффициента корреляции Пирсона (синий - высокие значения корреляции, красный - низкие значения). Четко выделяется несколько кластеров сильно зависимых между собой переменных.

2) Wrapper

Здесь используются алгоритмы классификации в качестве меры качества набора отобранных переменных. Оптимальным решением является полный перебор всех сочетаний переменных, поскольку при сложных взаимосвязях между переменными

вполне возможны ситуации, когда две переменные по отдельности не являющиеся дискриминаторными при добавлении третьей становятся таковыми. Очевидно, что полный перебор вычислительно не возможен при сколько-нибудь значительном числе переменных.

Попыткой преодолеть это “проклятие размерности” является применение генетических алгоритмов для поиска оптимального набора переменных. Другой стратегией является включение/исключение переменных по одной с одновременным контролем значения Akaike Information Criteria или Bayes Information Criteria .

Для этой группы методов обязательно применение кросс-валидации. Подробнее об этом написано в разделе о сравнении классификаторов.

Классификация

Задача - построить решающее правило, которое позволит относить вновь обработанный образец в тот или иной класс.

Обучение без учителя - кластерный анализ. Это поиск наилучших (в некотором смысле) группировок объектов. К сожалению, обычно нужно задавать число кластеров a priori, либо выбирать порог отсечения (для иерархической кластеризации). Это всегда вносит неприятный произвол.

Обучение с учителем : нейронные сети, SVM, decision trees, …

Требуется большая выборка с заранее отклассифицированными объектами.

Обычно работает лучше, чем обучение без учителя.Кросс-валидация - при отсутствии тестовой выборки. Возникает проблема переобучения (overfitting)

Важным и простым тестом, который редко проводят, является запуск обученного классификатора на случайных данных. Сгенерируйте матрицу с размером равным размеру исходной выборки, заполните случайным шумом или нормальным распределением, проведите все методики, включая нормализацию, отбор переменных и обучение. В случае, если получаются разумные результаты (т.е. вы научились распознавать случайный шум) - будет меньше оснований верить и в построенный классификатор.

Есть и более простой способ - просто измените случайным образом метки классов для каждого объекта, не трогая при этом остальные переменные. Тем самым опять получится бессмысленный набор данных, на котором стоит прогнать классификатор.

Мне кажется, что доверять построенному классификатору можно лишь в том случае, если был выполнен хотя бы один из приведенных тестов на распознавание случайных данных.

ROC - кривая

Receiver-Operating Characteristic curve

. Используется для представления результатов классификации на 2 класса при условии, что известен ответ, т.е. известно правильное разбиение.

. Предполагается, что у классификатора имеется параметр(точка отсечения), варьируя который получается то или иное разбиение на два класса.

При этом определяется доля ложно положительных (FP ) и ложноотрицательных результатов (FN ). Рассчитывается чувствительность и специфичность, строиться график в координатах (1-специфичность, чувствительность). При варьировании параметра классификатора получаются различные значения FP и FN , и точка перемещается по ROC -кривой.

. Точность = (TP +TN ) / (TP +FP +FN +TN )

. Чувствительность = TP / TP+FN

. Специфичность = TN / TN+FP

Что является “положительным” событием - зависит от условий задачи. Если прогнозируется вероятность наличия заболевания, то положительный исход - класс “больной пациент”, отрицательный исход - класс “здоровый пациент”

Самое наглядное объяснение (с отличными java -апплетами иллюстрирующими суть идеи ROC ) я видел на http://www.anaesthetist.com/mnm/stats/roc/Findex.htm

ROC-curve:

. Удобно использовать для анализа сравнительной эффективности двух классификаторов.

. Чем ближе кривая к левому верхнему углу, тем выше предсказательная способность модели.

. Диагональная линия соответствует “бесполезному классификатору”, т.е. полной неразличимости классов

. Визуальное сравнение не всегда позволяет точно оценить какой классификатор предпочтительнее.

. AUC - Area Under Curve -численная оценка, позволяющая сравнивать кривые ROC .

. Значения от 0 до 1.

Сравнение двух ROC- кривых

Площадь под кривой (AUC ) как мера для сравнения классификаторов.

Другие примеры ROC -кривых приведены в разделе посвященном разведочному анализу.

Сравнительный анализ классификаторов

Существует множество вариантов в применении методов распознавания образов. Важной задачей является сравнение между собой различных подходов и выбор наилучшего.

Наиболее распространенный сегодня способ сравнения классификаторов в статьях по протеомике (и не только) - это кросс-валидация. На мой взгляд, смысла в однократном применении процедуры кросс-валидации немного. Более разумный подход состоит в запуске кросс-валидации несколько раз (в идеале чем больше - тем лучше) и построении доверительных интервалов для оценки точности классификации. Наличие доверительных интервалов позволяет обоснованно решать является ли, например, улучшение качества классификации на 0.5% статистически значимым или нет. К сожалению, только в малом числе работ встречаются доверительные интервалы для точности, чувствительности и специфичности. Цифры же приводимые в других работах по этой причине трудно сравнивать между собой, поскольку не указан размах возможных значений.

Другим вопросом является выбор типа кросс-валидации. Мне больше нравится 10-fold или 5-fold кросс-валидация вместо leave -one -out .

Конечно, использование кросс-валидации это “акт отчаяния”. В идеале, выборка должна быть разбита на 3 части: на первой части строится модель, на второй части оптимизируются параметры этой модели, на третьей части производится проверка. Кросс-валидация - это попытка избежать этих построений, и оправдана лишь при малом числе образцов.

Из многочисленных запусков процедуры кросс-валидации можно почерпнуть и другую полезную информацию. Например, интересно посмотреть на каких объектах процедура распознавания ошибается чаще. Возможно, это ошибки в данных, выбросы или другие интересные случаи. Изучив на характерные свойства этих объектов иногда можно понять, в каком направлении стоит улучшать вашу процедуру классификации.

Ниже приведена таблица сравнения классификаторов для работы Moshkovskii et al , 2007. В качестве классификаторов использовались SVM и логистическая регрессия (LR ). Методамиотборапризнаковявлялись RFE (Re сursive Feature Elimination) и Top Scoring Pairs(TSP). Использование доверительных интервалов позволяет обоснованно судить о значимых преимуществах различных схем классификаций.

Литература

Здесь приведены некоторые книги и статьи, которые могут оказаться полезными при анализе протеомных данных.

C. Bishop, Neural Networks for Pattern Recognition

* Berrar, Dubitzky, Granzow. Practical approach to microarray data analysis (Kluwer, 2003). Книга посвящена обработке microarray (хотя я бы не стал рекомендовать ее для знакомства с предметом), но есть и пара интересных глав. Иллюстрация с влиянием выбросов на коэффициенты корреляции взята оттуда.

Литература, обозначенная знаками * есть в электронном виде, и автор делится ею безДвозДмездно (т.е. даром)

В книге, написанной в 1977 г. известным американским специалистом по математической статистике, изложены основы разведочного анализа данных, т.е. первичной обработки результатов наблюдений, осуществляемой посредством простейших средств - карандаша, бумаги и логарифмической линейки. На многочисленных примерах автор показывает, как представление наблюдений в наглядной форме с помощью схем, таблиц и графиков облегчает выявление закономерностей и подбор способов более глубокой статистической обработки. Изложение сопровождается многочисленными упражнениями с привлечением богатого материала из практики. Живой, образный язык облегчает понимание излагаемого материала.

Джон Тьюки. Анализ результатов наблюдений. Разведочный анализ. – М.: Мир, 1981. – 696 с.

Скачать конспект (краткое содержание) в формате или , примеры в формате

На момент публикации заметки книгу можно найти только в букинистических магазинах.

Автор подразделяет статистический анализ на два этапа: разведочный и подтверждающий. Первый этап включает преобразование данных наблюдений и способы их наглядного представления, позволяющие выявить внутренние закономерности, проявляющиеся в данных. На втором этапе применяются традиционные статистические методы оценки параметров и проверки гипотез. Настоящая книга посвящена разведочному анализу данных (о подтверждающем анализе см. ). Для чтения книги не требуется предварительных знаний по теории вероятностей и математической статистике.

Прим. Багузина. Учитывая год написания книги, автор сосредотачивается на наглядном представлении данных с помощью карандаша, линейки и бумаги (иногда миллиметровой). На мой взгляд, сегодня наглядное представление данных связано с ПК. Поэтому я попытался совместить оригинальные идеи автора и обработку в Excel. Мои комментарии набраны с отступом.

Глава 1. КАК ЗАПИСЫВАТЬ ЧИСЛА («СТЕБЕЛЬ С ЛИСТЬЯМИ»)

График имеет наибольшую ценность тогда, когда он вынуждает нас заметить то, что мы совсем не ожидали увидеть. Представление чисел в виде стебля и листьев позволяет выявить закономерности. Например, приняв основанием стебля десятки, число 35 можно отнести к стеблю 3. Лист будет равен 5. Для числа 108 стебель – 10, лист – 8.

В качестве примера я взял 100 случайных чисел, распределенных по нормальному закону со средним 10 и стандартным отклонением 3. Чтобы получить такие числа я воспользовался формулой =НОРМ.ОБР(СЛЧИС();10;3) (рис. 1). Откройте приложенный файл Excel. Нажимая F9, вы будете генерировать новый ряд случайных чисел.

Рис. 1. 100 случайных чисел

Видно, что числа в основном распределены в диапазоне от 5 до 16. Однако заметить какую-либо интересную закономерность сложно. График «стебель и листья» (рис. 2) выявляет нормальное распределение. В качестве ствола были взяты пары соседних чисел, например, 4-5. Листья отражают число значений в этом диапазоне. В нашем примере таких значений 3.

Рис. 2. График «стебель и листья»

В Excel есть две возможности, позволяющие быстро изучить частотные закономерности: функция ЧАСТОТА (рис. 3; подробнее см. ) и сводные таблицы (рис. 4; подробнее см. , раздел Группировка числовых полей ).

Рис. 3. Анализ с помощью функции массива ЧАСТОТА

Рис. 4. Анализ с помощью сводных таблиц

Представление в виде стебля с листьями (частотное представление) позволяет выявить следующие особенности данных:

- разделение на группы;

- несимметричное спадание к концам - один «хвост» длиннее другого;

- неожиданно «популярные» и «непопулярные» значения;

- относительно какого значения «центрированы» наблюдения;

- как велик разброс данных.

Глава 2. ПРОСТЫЕ СВОДКИ ДАННЫХ – ЧИСЛОВЫЕ И ГРАФИЧЕСКИЕ

Представление чисел в виде стебля с листьями позволяет воспринять общую картину выборки. Перед нами стоит задача научиться выражать в сжатом виде наиболее часто встречающиеся общие особенности выборок. Для этого используются сводки данных. Однако, несмотря на то, что сводки могут быть очень полезными, но они не дают всех подробностей выборки. Если этих подробностей не так много, чтобы в них запутаться, лучше всего иметь перед глазами полные данные, размещенные отчетливо удобным для нас способом. Для больших массивов данных сводки необходимы. Мы не предполагаем и не ожидаем, что они заменят полные данные. Разумеется, нередко бывает, что добавление подробностей мало что дает, но важно осознать, что иногда подробности дают многое.

Если для характеристики выборки как целого нам нужно выбрать несколько чисел, которые легко найти, то нам наверняка понадобятся:

- крайние значения - наибольшее и наименьшее, которые мы пометим символом «1» (в соответствии с их рангом или глубиной);

- какое-то срединное значение.

Медиана = срединное значение.

Для ряда, представленного в виде стебля с листьями, срединное значение легко найти подсчетом вглубь от любого из концов, приписывая крайнему значению ранг «1». Таким образом, каждое значение в выборке получает свой ранг . Счет можно начинать с любого конца. Наименьший из двух получаемых таким образом рангов, которые можно приписать одному и тому же значению, мы назовем глубиной (рис. 5). Глубина крайнего значения всегда 1.

Рис. 5. Определение глубины на основе двух направлений ранжирования

глубина (или ранг) медианы = (1 + число значений)/2

Если мы хотим добавить еще два числа, чтобы образовать 5-числовую сводку, то естественно определять их подсчетом до половины расстояния от каждого из концов к медиане. Процесс нахождения медианы, а затем и этих новых значений можно представить себе, как складывание листа бумаги. Поэтому эти новые значения естественно назвать сгибами (сейчас чаще используется термин квартиль ).

В свернутом виде ряд из 13 значений может выглядеть, например, так:

Пять чисел для характеристики ряда в порядке возрастания будут: –3,2; 0,1; 1,5; 3,0; 9,8 - по одному в каждой точке перегиба ряда. Пять чисел (крайние значения, сгибы, медиана), из которых состоит 5-числовая сводка, мы будем изображать в виде следующей простой схемы:

где слева мы показали количество чисел (отмечено знаком #), глубину медианы (буквой М), глубину сгибов (буквой С) и глубину крайних значений (всегда 1, больше ничем отмечать не надо).

На рис. 8 показано, как изобразить 5-числовую сводку графически. Такого типа график называется «ящик с усами».

Рис. 8. Схематическая диаграмма или ящик с усами

К сожалению, Excel стандартно строит биржевые диаграммы, основанные только на трех или четырех значениях (рис. 9; как обойти это ограничение см. ). Для построения 5-числовой сводки можно воспользоваться статистическим пакетом R (рис. 10; подробнее см. Базовые графические возможности R: диаграммы размахов ; если вы не знакомы с пакетом R, можно начать с ). Функция boxplot() в R помимо 5 чисел отражает также выбросы (о них чуть позже).

Рис. 9. Возможные типы биржевых диаграмм в Excel

Рис. 10. Ящичная диаграмма в R; для построения такого графика достаточно выполнить команду boxplot(count ~ spray, data = InsectSprays), будут загружены данные, хранящиеся в программе, и построен представленный график

При построении диаграммы «ящик с усами» мы будем придерживаться следующей простой схемы:

- «С-ширина» = разность между значениями двух сгибов;

- «шаг» - величина, в полтора раза большая, чем С-ширина;

- «внутренние барьеры» находятся снаружи сгибов на расстоянии одного шага;

- «наружные барьеры» - снаружи на один шаг дальше внутренних;

- значения между внутренним и соседним наружным барьерами будут «внешними»;

- значения за наружными барьерами будем называть «отскакивающими» (или выбросы);

- «размах» = разность между крайними значениями.

Рис. 19. Вычисление скользящей медианы: (а) подробно для части данных; (б) для всей выборки

Рис. 20. Сглаженная кривая

Глава 10. ИСПОЛЬЗОВАНИЕ ДВУХФАКТОРНОГО АНАЛИЗА

Наступило время рассмотреть двухфакторный анализ - как вследствие его важности, так и потому, что он является введением в разнообразные методы исследования. В основе двухфакторной таблицы (таблицы «откликов») лежат:

- один вид откликов;

- два фактора - и каждый из них проявляется в каждом наблюдении.

Двухфакторная таблица остатков. Анализ «строка-плюс-столбец». На рис. 21 приведены среднемесячные значения температуры для трех мест в Аризоне.

Рис. 21. Среднемесячные температуры в трех городах Аризоны, °F

Определим медиану по каждому месту, и вычтем ее из отдельных значений (рис. 22).

Рис. 22. Значения аппроксимации (медианы) для каждого города и остатки

Теперь определим аппроксимацию (медиану) по каждой строке, и вычтем ее из значений строки (рис. 23).

Рис. 23. Значения аппроксимации (медианы) для каждого месяца и остатки

Для рис. 23 мы вводим понятие «эффект». Число –24,7 представляет собой эффект столбца, а число 19,1 - эффект строки. Эффект показывает, как проявляется фактор или множество факторов в каждой из наблюденных величин. Если проявляющаяся часть фактора больше, чем то, что остается, то легче разглядеть и понять, что происходит с данными. Число, которое было вычтено из всех без исключения данных (здесь 70,8), называем «общее». Оно есть проявление всех факторов, общих для всех данных. Таким образом, для величин на рис. 23 справедлива формула:

Это и есть схема конкретного анализа «строка-ПЛЮС-столбец». Мы возвращаемся к нашей старой уловке - попытаться найти простое частичное описание - частичное описание, которое легче воспринимается - частичное описание, вычитание которого даст нам возможность глубже взглянуть на то, что еще не было описано.

Что нового мы сможем узнать благодаря полному двухфакторному анализу? Самый большой остаток, равный 1,9, мал по сравнению с величиной изменения эффекта от пункта к пункту и от месяца к месяцу. Во Флагстаффе приблизительно на 25°F прохладнее, чем в Финиксе, в то время как в Юме на 5–6°F теплее, чем в Финиксе. Последовательность эффектов месяцев монотонно убывает от месяца к месяцу, сначала медленно, затем быстро, затем снова медленно. Это похоже на симметрию относительно октября (такую закономерность я ранее наблюдал на примере продолжительности дня; см. . – Прим. Багузина ); Мы сняли обе завесы - эффект сезона и эффект места. После этого мы смогли увидеть довольно многое из того, что ранее оставалось незамеченным.

На рис. 24 приведена двухфакторная диаграмма . Хотя основное на этом рисунке - это аппроксимация, мы не должны пренебрегать остатками. В четырех точках мы нарисовали короткие вертикальные черточки. Длины этих черточек равны величинам соответствующих остатков, так что координаты вторых концов представляют не значения аппроксимации, а

Данные = аппроксимация ПЛЮС остаток.

Рис. 24. Двухфакторная диаграмма

Заметим также, что свойство этой или любой другой двухфакторной диаграммы - «шкала лишь в одном направлении», задающими вертикальный размер, т.е. пунктирными горизонтальными линиями, проведенными по бокам картинки, и отсутствием какого-либо размера в горизонтальном направлении.

О возможностях Excel см. . Любопытно, что некоторые формулы, использованные в этой заметке, носят имя Тьюки

Дальнейшее изложение, на мой взгляд, стало совсем сложным…

В STATISTICA реализованы классические методы кластерного анализа, включая методы k-средних, иерархической кластеризации и двухвходового объединения.

Данные могут поступать как в исходном виде, так и в виде матрицы расстояний между объектами.

Наблюдения и переменные можно кластеризовать, используя различные меры расстояния (евклидово, квадрат евклидова, манхэттеновское, Чебышева и др.) и различные правила объединения кластеров (одиночная, полная связь, невзвешенное и взвешенное попарное среднее по группам и др.).

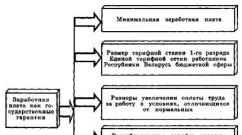

Постановка задачи

Исходный файл данных содержит следующую информацию об автомобилях и их владельцах:

Целью данного анализа является разбиение автомобилей и их владельцев на классы, каждый из которых соответствует определенной рисковой группе. Наблюдения, попавшие в одну группу, характеризуются одинаковой вероятностью наступления страхового случая, которая впоследствии оценивается страховщиком.

Использование кластер-анализа для решения данной задачи наиболее эффективно. В общем случае кластер-анализ предназначен для объединения некоторых объектов в классы (кластеры) таким образом, чтобы в один класс попадали максимально схожие, а объекты различных классов максимально отличались друг от друга. Количественный показатель сходства рассчитывается заданным способом на основании данных, характеризующих объекты.

Масштаб измерений

Все кластерные алгоритмы нуждаются в оценках расстояний между кластерами или объектами, и ясно, что при вычислении расстояния необходимо задать масштаб измерений.

Поскольку различные измерения используют абсолютно различные типы шкал, данные необходимо стандартизовать (в меню Данные выберете пункт Стандартизовать ), так что каждая переменная будет иметь среднее 0 и стандартное отклонение 1.

Таблица со стандартизованными переменными приведена ниже.

Шаг 1. Иерархическая классификация

На первом этапе выясним, формируют ли автомобили "естественные" кластеры, которые могут быть осмыслены.

Выберем Кластерный анализ в меню Анализ - Многомерный разведочный анализ для отображения стартовой панели модуля Кластерный анализ . В этом диалоге выберем Иерархическая классификация и нажмем OK .

Нажмем кнопку Переменные , выберем Все , в поле Объекты выберем Наблюдения (строки ). В качестве правила объединения отметим Метод полной связи , в качестве меры близости - Евклидово расстояние . Нажмем ОК .

Метод полной связи определяет расстояние между кластерами как наибольшее расстояние между любыми двумя объектами в различных кластерах (т.е. "наиболее удаленными соседями").

Мера близости, определяемая евклидовым расстоянием, является геометрическим расстоянием в n- мерном пространстве и вычисляется следующим образом:

Наиболее важным результатом, получаемым в результате древовидной кластеризации, является иерархическое дерево. Нажмем на кнопку Вертикальная дендрограмма .

Вначале древовидные диаграммы могут показаться немного запутанными, однако после некоторого изучения они становятся более понятными. Диаграмма начинается сверху (для вертикальной дендрограммы) с каждого автомобиля в своем собственном кластере.

Как только вы начнете двигаться вниз, автомобили, которые "теснее соприкасаются друг с другом" объединяются и формируют кластеры. Каждый узел диаграммы, приведенной выше, представляет объединение двух или более кластеров, положение узлов на вертикальной оси определяет расстояние, на котором были объединены соответствующие кластеры.

Шаг 2. Кластеризация методом К средних

Исходя из визуального представления результатов, можно сделать предположение, что автомобили образуют четыре естественных кластера. Проверим данное предположение, разбив исходные данные методом К средних на 4 кластера, и проверим значимость различия между полученными группами.

В Стартовой панели модуля Кластерный анализ выберем Кластеризация методом К средних .

Нажмем кнопку Переменные и выберем Все , в поле Объекты выберем Наблюдения (строки ), зададим 4 кластера разбиения.

Метод K-средних

заключается в следующем: вычисления начинаются с k случайно выбранных наблюдений (в нашем случае k=4), которые становятся центрами групп, после чего объектный состав кластеров меняется с целью минимизации изменчивости внутри кластеров и максимизации изменчивости между кластерами.

Каждое следующее наблюдение (K+1) относится к той группе, мера сходства с центром тяжести которого минимальна.

После изменения состава кластера вычисляется новый центр тяжести, чаще всего как вектор средних по каждому параметру. Алгоритм продолжается до тех пор, пока состав кластеров не перестанет меняться.

Когда результаты классификации получены, можно рассчитать среднее значение показателей по каждому кластеру, чтобы оценить, насколько они различаются между собой.

В окне Результаты метода К средних выберем Дисперсионный анализ для определения значимости различия между полученными кластерами.

Итак, значение р<0.05, что говорит о значимом различии.

Нажмем кнопку Элементы кластеров и расстояния для просмотра наблюдений, входящих в каждый из кластеров. Опция также позволяет отобразить евклидовы расстояния объектов от центров (средних значений) соответствующих им кластеров.

Первый кластер:

Второй кластер:

Третий кластер:

Четвертый кластер:

Итак, в каждом из четырех кластеров находятся объекты со схожим влиянием на процесс убытков.